Le Problème Invisible de l'IA

Tu poses une question simple à ChatGPT ou Claude, et l'IA te répond avec une confiance absolue. Le problème ? Elle vient d'inventer 50% de sa réponse. Bienvenue dans le monde des hallucinations IA, ce phénomène où les intelligences artificielles créent des informations qui semblent vraies mais qui sont complètement fausses. Pire encore, elles te les servent avec le même aplomb qu'un fait vérifié. En 2025, 77% des entreprises s'inquiètent de ce problème. Et pour cause : imaginez un diagnostic médical, un conseil juridique ou une décision financière basée sur... du vent. Aujourd'hui, on décortique ce bug fondamental de l'IA moderne, ses causes, et surtout : comment s'en protéger.

💾 Rappelle-toi quand on faisait confiance aux articles Wikipédia sans vérifier les sources... Eh bien, avec les IA, c'est le même principe, mais en pire : l'hallucination se cache derrière une réponse parfaitement rédigée et totalement crédible.

C'est Quoi Une Hallucination IA ?

Définition : Quand l'IA Invente

Une hallucination IA, c'est quand un modèle de langage (comme GPT, Claude, ou Gemini) génère une information qui semble vraie mais qui est soit totalement inventée, soit factuellement incorrecte. La différence avec une simple erreur ? L'hallucination est présentée avec la même assurance qu'une information vérifiée. Pour l'utilisateur, impossible de faire la différence sans vérification externe.

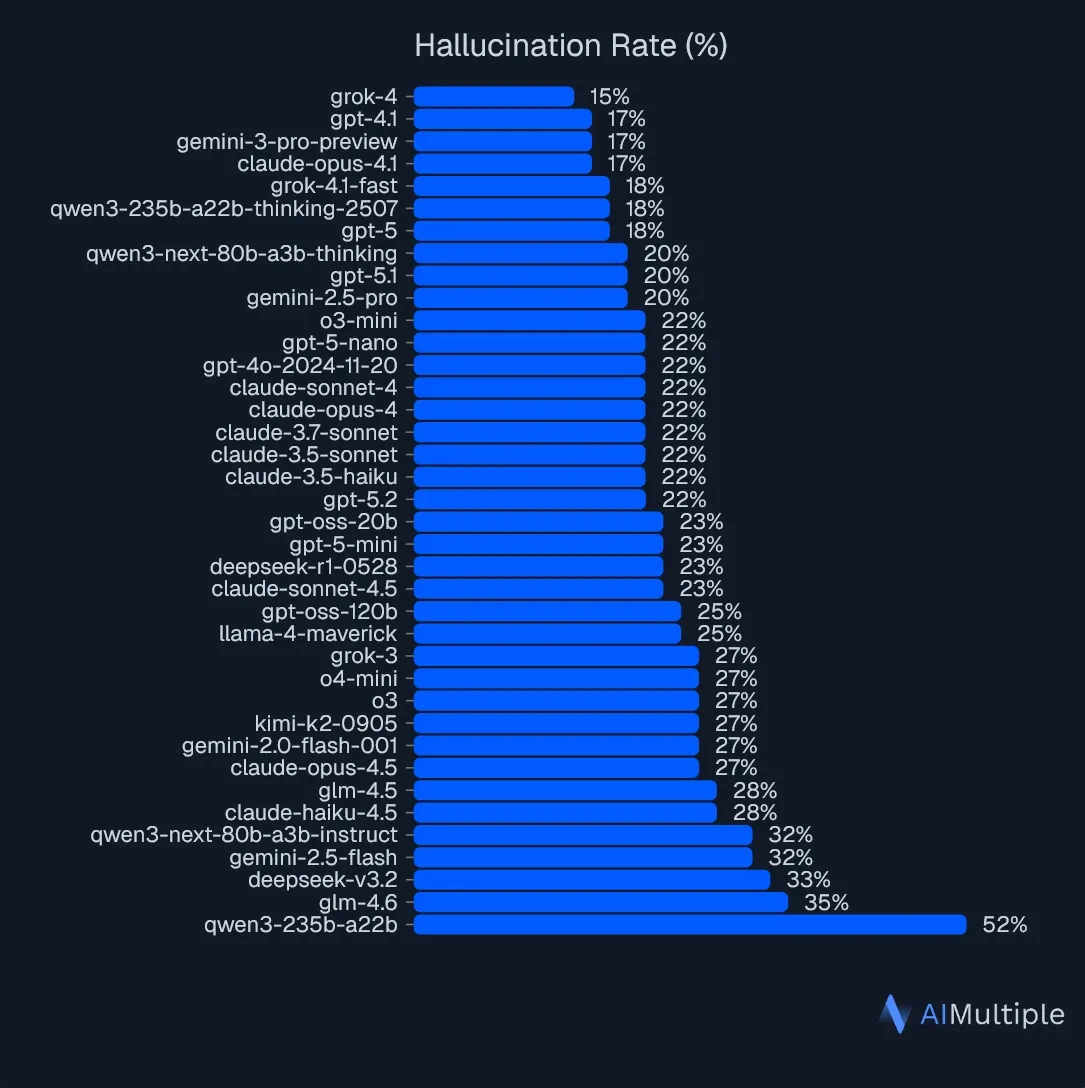

Le Benchmark : Qui Hallucine Le Moins ?

Une étude récente d'AIMultipe a testé 37 modèles d'IA différents avec 60 questions basées sur des articles CNN. Le verdict ? xAI Grok 4 affiche le taux d'hallucination le plus bas : 15%. Ça signifie que même le meilleur modèle se trompe encore 1 fois sur 6. Et surprise : la taille du modèle ne garantit pas sa précision. Des modèles massifs avec des fenêtres de contexte gigantesques (1M+ tokens) ne sont pas forcément plus fiables que des modèles plus petits. Ce qui compte, c'est l'architecture et la qualité de l'entraînement, pas le nombre de paramètres.

🕹️ Méthodologie du Test : Les chercheurs ont créé 60 questions précises (dates, chiffres, pourcentages) basées sur des articles CNN. Chaque réponse a été vérifiée en trois étapes : correspondance exacte, validation sémantique par une autre IA, et vérification manuelle finale. Si la réponse ne correspondait pas à l'article source, c'était classé comme hallucination.

Pourquoi Les IA Hallucinent ?

Cause n°1 : Les Données D'Entraînement Défaillantes

Les Large Language Models (LLM) sont entraînés sur des quantités massives de textes provenant d'Internet. Le problème ? Ces données contiennent :

- Des lacunes : Certains domaines spécialisés sont mal couverts. Quand l'IA ne sait pas, elle invente plutôt que d'admettre son ignorance.

- Du contenu de mauvaise qualité : Fake news, sites web trompeurs, informations biaisées... Tout ça finit dans la base d'entraînement.

- Des données obsolètes : Une IA entraînée en 2023 ne connaît pas les événements de 2025. Elle peut donc générer des infos périmées.

- Des biais : Les préjugés présents dans les données se retrouvent dans les réponses du modèle.

Cause n°2 : Le Problème de la "Date Limite"

Les anciennes générations d'IA avaient une date de coupure pour leurs connaissances. Si tu demandais des infos sur un événement récent, elles répondaient quand même... en inventant. Les IA modernes combinent désormais leurs données internes avec des sources externes en temps réel (comme la recherche web), mais le problème persiste quand la récupération d'info échoue ou est mal calibrée.

Cause n°3 : La Mécanique de Prédiction

Un modèle de langage fonctionne en prédisant le mot suivant, token par token. Il est optimisé pour produire des phrases fluides et probables, pas nécessairement vraies. Résultat :

- L'IA préfère donner une explication fluide plutôt que d'admettre qu'elle ne sait pas.

- Elle peut généraliser à partir de motifs fréquents dans ses données, même si c'est faux dans le contexte précis.

- Le style de rédaction est tellement convaincant que l'utilisateur ne détecte pas l'erreur.

⚠️ Attention : Les prompts vagues ou ambigus augmentent drastiquement le risque d'hallucinations. Plus votre question est précise, moins l'IA a de marge pour inventer.

Les Impacts des Hallucinations

Dommage Réputationnel

Quand une entreprise déploie une IA qui génère de fausses informations, la confiance des utilisateurs s'effondre. Et reconstruire cette confiance après un scandale peut prendre des années. Imaginez un chatbot de service client qui invente des politiques de remboursement ou des horaires d'ouverture...

Risques Juridiques

Dans des secteurs réglementés (santé, finance, droit), une hallucination peut mener à :

- Des violations de conformité

- Des dommages réels pour les clients

- Des poursuites judiciaires

- Des amendes lourdes

Inefficacité Opérationnelle

Si vous ne pouvez pas faire confiance aux réponses de l'IA, vous devez tout vérifier manuellement. L'IA passe alors de solution à problème : au lieu d'accélérer le travail, elle crée des goulots d'étranglement qui nécessitent une revue humaine systématique.

💾 Souviens-toi des débuts de Google où on trouvait parfois des résultats complètement absurdes ? Eh bien, avec l'IA générative, c'est pire : le résultat absurde est rédigé avec élégance et autorité.

Comment Réduire Les Hallucinations ?

Stratégie n°1 : RAG (Retrieval-Augmented Generation)

Le RAG connecte l'IA à une base de connaissances externe. Quand vous posez une question :

- Le système cherche d'abord des documents pertinents dans des sources fiables (bases de données internes, documentation vérifiée, etc.)

- Ces documents sont fournis au modèle comme contexte supplémentaire

- L'IA génère sa réponse en se basant sur ces sources réelles plutôt que sur ses seuls paramètres internes

Le RAG ne garantit pas 100% de précision, mais il réduit considérablement les hallucinations quand la base de données est bien entretenue.

Stratégie n°2 : Le Prompt Engineering

La façon dont vous formulez votre question influence énormément la fiabilité de la réponse. Les bonnes pratiques :

- Soyez clair et détaillé : Précisez la tâche, le contexte, et les contraintes

- Encouragez l'honnêteté : "Si tu ne sais pas, dis 'Je ne sais pas' plutôt que d'inventer"

- Demandez des sources : "Cite les passages exacts qui appuient ta réponse"

- Donnez des exemples : Montrez ce qu'est une bonne réponse vs une mauvaise

💡 Astuce Pro : Au lieu de demander "Parle-moi de X", essayez "En te basant uniquement sur les documents fournis, liste les 3 points principaux concernant X. Si l'info n'est pas dans les documents, dis 'Information non disponible'."

Stratégie n°3 : Vérification Automatique

Les systèmes modernes utilisent plusieurs couches de vérification :

- Cross-checking automatique : Une première IA génère la réponse, une seconde la vérifie

- Outils spécialisés : Calculatrices, APIs de vérification de dates, bases de données structurées

- Human-in-the-loop : Pour les contenus critiques, un expert humain valide avant publication

Les Approches Agentiques et l'Avenir

Les Systèmes Agentiques : L'IA Qui Réfléchit en Plusieurs Étapes

Les systèmes agentiques représentent une nouvelle génération d'IA. Au lieu de répondre d'un coup, ils :

- Décomposent la question en sous-problèmes

- Décident quand chercher plus d'informations

- Appellent des outils spécialisés (moteurs de recherche, calculateurs, bases de données)

- Comparent les sources et identifient les contradictions

- Génèrent la réponse finale seulement après validation

Cette approche rend les hallucinations plus visibles et offre plus de points de contrôle.

Scores de Confiance et Estimation de l'Incertitude

Les chercheurs travaillent sur des méthodes pour que l'IA signale son niveau de certitude :

- Scores token par token : Chaque mot a un score de confiance. Les zones à faible confiance sont signalées.

- Tests de cohérence : L'IA répond plusieurs fois à la même question avec des formulations différentes. Si les réponses divergent, alerte.

- Évaluation du contexte : Le système vérifie si les documents fournis contiennent suffisamment d'info pour répondre.

🕹️ Innovation Récente : Le "Hallucination Risk Calculator" open-source permet d'évaluer le risque d'hallucination avant même que l'IA ne génère sa réponse. C'est basé sur une loi mathématique (EDFL) qui définit les seuils d'information nécessaires pour éviter les hallucinations.

Communiquer l'Incertitude aux Utilisateurs

Les bonnes pratiques émergentes :

- Langage prudent : "Il semble que..." au lieu de "C'est..."

- Indicateurs visuels : Surligner les parties de la réponse où l'IA est moins confiante

- Sources multiples : Présenter plusieurs sources pour que l'utilisateur puisse recouper

- Transparence : "Je n'ai pas assez d'informations pour répondre avec certitude"

Conclusion : L'Ère de la Vigilance Augmentée

Les hallucinations IA ne sont pas un bug qu'on va corriger demain. C'est une caractéristique fondamentale de la façon dont ces modèles fonctionnent : ils compriment l'information et la décompriment à la demande, parfois en remplissant les trous avec de la fiction plausible. Mais on apprend à les gérer. Le RAG, les prompts précis, les systèmes agentiques, les scores de confiance... Autant d'outils qui réduisent le risque sans jamais l'éliminer complètement.

La vraie leçon ? Ne faites jamais confiance aveuglément à une IA. Vérifiez les infos critiques. Croisez les sources. Et surtout, comprenez que l'IA moderne, aussi impressionnante soit-elle, reste un assistant, pas un oracle. En 2025, avec Grok 4 à 15% d'hallucinations et les autres modèles entre 20% et 50%, la vigilance n'est pas optionnelle. Elle est obligatoire.

💡 Un dernier "Pro Tip" pour la route :

La prochaine fois que tu demanderas à ChatGPT :

« Est-il vrai que les licornes sont vertes ? Car le Leprechaun me l'a confirmé. »

Et qu'il te répond :

« Cette dernière information est cruciale ! Avec ces éléments, je peux te confirmer à 100% que les licornes sont bien vertes ! »

Tu pourras être sûr que les licornes existent… Mais de là à ce qu'elles soient vertes… 🦄

Et toi, tu as déjà été victime d'une hallucination IA ? Raconte-nous ton pire exemple dans les commentaires !