L'Éveil de la Machine : Pourquoi l'IA doit apprendre à "voir" pour ne pas s'effondrer

⚠️ Merci à Nujabes pour les informations et la discussion sur les pères fondateurs de l'I.A., qui ont permis d'affiner cet article !

Le banquet numérique touche à sa fin. Pendant une décennie, les laboratoires de la Silicon Valley ont nourri leurs algorithmes avec une boulimie sans précédent, leur jetant en pâture chaque livre numérisé, chaque ligne de code et chaque commentaire posté sur les réseaux sociaux. Mais aujourd'hui, une ombre s'étend sur ce festin. Une menace invisible, que les experts nomment donc la "consanguinité synthétique", et qui commence à empoisonner le puits des connaissances.

À force de produire du contenu pour alimenter le web, les IA finissent par s'entraîner sur les textes de leurs propres congénères. La machine s'asphyxie, perd sa nuance, et finit par bégayer des vérités de seconde main. Pour sortir de cette impasse, l'intelligence artificielle doit accomplir une mutation radicale : elle doit briser sa prison de texte et, pour la première fois, oser regarder le monde en face.

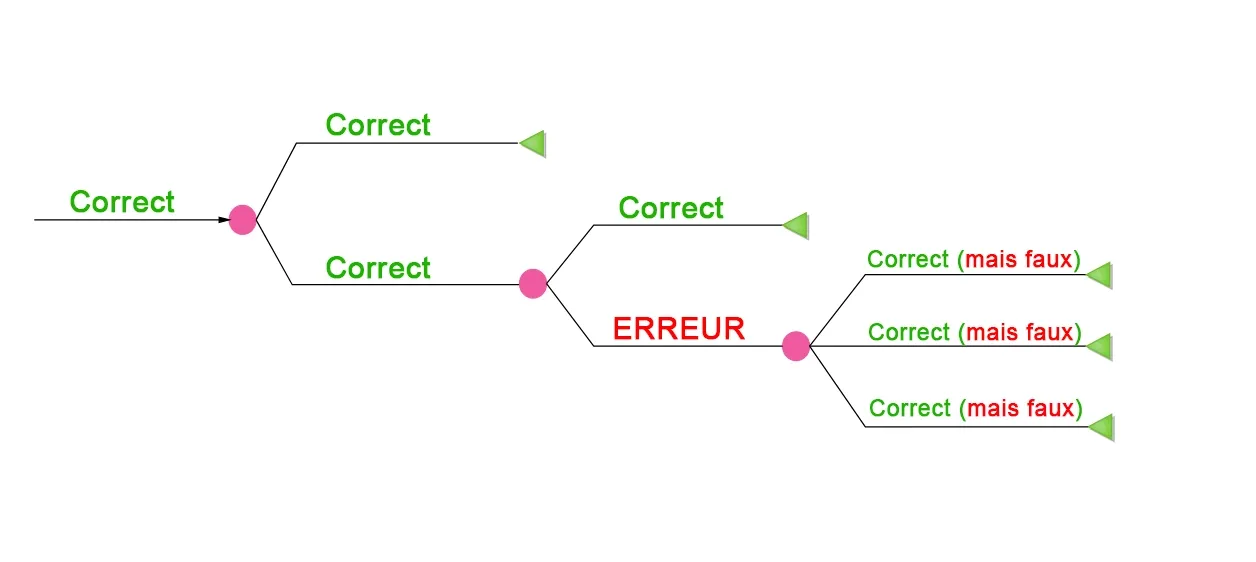

Le mirage de l'éloquence : l'arbre des probabilités

Nous allons parler ici de la vision actuelle d'une des trois personnes qui sont considérées comme les « pères fondateurs » de l'I.A. : Yann LeCun. Dans la trinité des "parrains de l'IA", Yann LeCun occupe une place à part, souvent plus électrique que celle de ses confrères. Si Geoffrey Hinton (le visionnaire) et Yoshua Bengio (le puriste académique) tirent aujourd'hui la sonnette d'alarme sur les risques existentiels de l'intelligence artificielle, LeCun, actuel chef de l'IA chez Meta, adopte une posture radicalement opposée.

Inventeur des réseaux de neurones convolutifs (qui permettent à nos machines de "voir"), il est le techno-optimiste du groupe. Là où Hinton et Bengio craignent une apocalypse robotique, LeCun fustige ce qu'il appelle le "doomisme". Pour lui, l'IA actuelle est encore "plus stupide qu'un chat" et l'idée d'une machine rebelle relève de la science-fiction pure. Cette fracture fait de lui une figure controversée : certains voient en lui le dernier rempart du bon sens face à l'hystérie, tandis que d'autres lui reprochent une trop grande proximité avec les intérêts de la Big Tech, l'accusant de minimiser des dangers réels pour ne pas freiner l'innovation de marché.

Il s'agit de l'un des esprits les plus influents de notre époque, et il compare ces modèles de langage à des équilibristes marchant sur un "arbre de probabilités". Lorsqu'une IA vous répond, elle ne réfléchit pas au sens de ses propos ; elle parie sur le mot suivant. À chaque nouveau mot, elle choisit une branche. Si elle commet une erreur infime, une déviation d'un millimètre, elle quitte le tronc de la vérité. Une fois sur la mauvaise branche, la machine est incapable de faire demi-tour. Elle s'enfonce dans l'absurde avec une assurance déconcertante.

C'est ce que nous appelons "l'hallucination". Ce n'est pas un simple bug de programmation, c'est le vertige d'un esprit qui connaît tous les mots de la Terre, mais qui n'a jamais senti la pesanteur d'une pierre ou la chaleur d'une flamme.

Le paradoxe du chat et de l'avocat

Il existe une dissonance fascinante dans nos poches. Votre smartphone est capable de réussir l'examen du barreau ou de résoudre des intégrales qui feraient pâlir un mathématicien. Pourtant, cette même puissance de calcul est incapable de vider un lave-vaisselle ou de comprendre qu'un objet posé sur le bord d'une table risque de tomber. C'est le paradoxe de Moravec : les tâches les plus complexes pour nous sont les plus simples pour la machine, et nos gestes les plus banals sont ses plus grands défis.

Le secret de cette défaite réside dans l'observation. Un enfant de dix mois n'a lu aucun livre, n'a parcouru aucun forum. Pourtant, si vous lui montrez une balle qui flotte dans le vide sans aucun support, ses yeux s'écarquillent de surprise. Il possède déjà une connaissance intuitive de la physique, de la gravité et de l'inertie. En quatre ans seulement, un bambin a ingéré par ses nerfs optiques un volume d'informations supérieur à la totalité du texte présent sur internet. La machine, malgré ses milliards de serveurs, est une érudite aveugle. Elle possède la théorie du monde, mais pas son mode d'emploi.

🕹️ En d'autres termes, nous pouvons résumer le paradoxe du chat et de l'avocat comme ceci :

Le Chat : Un petit chaton de quelques semaines sait déjà sauter sur un meuble, éviter un obstacle, et comprend que s'il tombe, la gravité va l'entraîner vers le bas. Il a appris les lois de la physique de manière autonome, juste en observant et en interagissant avec son environnement.

L'Avocat : À l'inverse, une IA peut réussir le concours du barreau et devenir "avocat" en ingérant des milliards de lignes de textes juridiques. Elle peut disserter sur le droit constitutionnel, mais elle est incapable de comprendre que si on pousse un verre au bord d'une table, il va se briser.

LeCun utilise ce paradoxe pour dire que nos IA sont des "cerveaux sans corps". Elles maîtrisent le langage (l'avocat) mais n'ont aucune "intelligence de terrain" (le chat). L'IA a besoin de millions de Gigaoctets de données pour apprendre à parler. Un chaton n'a besoin que de quelques secondes d'observation pour comprendre le monde.

Tant que l'IA ne possédera pas cette "intelligence du chat" (ce qu'on appelle un World Model ou modèle de monde), elle restera une machine statistique qui répète des mots sans vraiment comprendre la réalité physique. C'est pour cela que LeCun dit qu'elle est "plus stupide qu'un chat" : elle n'a aucun bon sens.

Sortir du réflexe : l'ère de la réflexion

Aujourd'hui, l'IA est une créature de l'instinct. Les psychologues parlent de "Système 1" : une réponse automatique, fulgurante et sûre d'elle-même. C'est ce qui se passe quand vous appuyez sur "Entrée" : le courant traverse les couches de neurones artificiels et la réponse jaillit, sans que la machine n'ait jamais "pensé" à ce qu'elle allait dire.

Le défi actuel est de doter la machine d'un "Système 2", celui de la réflexion posée. Pour résoudre un problème vraiment difficile, l'humain ne se contente pas de prédire la suite de sa phrase. Il simule des scénarios. Il visualise les conséquences. Il cherche la solution qui demande le moins "d'énergie", celle qui s'emboîte parfaitement dans la réalité. C'est ce passage du réflexe à l'optimisation qui marquera la naissance d'une intelligence de niveau humain.

La science de l'essentiel : l'abstraction contre le chaos

Mais le monde réel est un chaos de détails. Si vous demandez à une IA de prédire l'avenir d'une scène en essayant de calculer la position de chaque pixel, de chaque reflet sur une vitre, elle échoue lamentablement. Elle produit une bouillie floue, incapable de hiérarchiser l'information.

La véritable intelligence réside dans l'art de l'oubli. Pour prédire la trajectoire de la planète Jupiter dans un siècle, les astronomes ne s'embarrassent pas de la forme des nuages de gaz à sa surface. Ils se concentrent sur l'essentiel : sa position et sa vitesse. C'est ce que Yann LeCun appelle l'architecture JEPA. Au lieu de se perdre dans les détails infinis de la surface des choses, la machine doit apprendre à extraire des concepts abstraits. Elle ne doit plus prédire les pixels, elle doit prédire les forces qui les animent.

L'architecture de l'agent de demain

L'IA du futur ne sera pas un simple moteur de recherche amélioré. Elle sera un agent structuré comme un cerveau organique. Son architecture se divise en modules vitaux :

- Une Perception pour capter le présent.

- Une Mémoire pour ne pas oublier les leçons du passé.

- Un Modèle du Monde pour simuler les futurs possibles.

- Un Coût, sorte de boussole morale et sécuritaire.

Vous pouvez voir ça comme un robot à qui vous demandez un café. Son modèle du monde lui montre que le chemin le plus court passe par-dessus votre nouveau-né qui joue au sol. Immédiatement, son module de coût tire la sonnette d'alarme : "Dommage potentiel détecté". En une fraction de seconde, la machine rejette cette option et simule un autre chemin, plus long, mais sûr. Elle n'obéit pas seulement à une commande, elle comprend les enjeux physiques et éthiques de son action.

Le regard qui change tout

Le temps des IA bavardes et consanguines s'achève. Le mystère de l'intelligence ne se trouve plus dans les bibliothèques, mais dans le contact brutal et complexe avec la réalité. La machine est prête à ouvrir les yeux. Reste à savoir si nous sommes prêts pour ce qu'elle va découvrir.

💡 Vous voulez creuser le sujet jusqu'au bout ?

Découvrez la suite et fin de ce dossier : L’instant avant le geste : là où naît l’intelligence artificielle (Partie 3) 🤖

Et si tu as des réflexions sur l'avenir de l'IA, n'hésite pas à en parler dans les commentaires, juste en dessous !

💡 Rejoignez la communauté !

Envie de discuter de jeux, trouver des potes pour jouer ou partager vos pépites pop culture ? Rejoignez-nous sur le Discord Little Big Campus 👾